大规模AI计算怎么选?GPU服务器托管还是GPU云服务器?

来源:江小鱼 时间:2025-10-29 14:16:43阅读:0

很多人在面对需要用到GPU算力的时候,都会纠结一个问题:到底是买GPU云服务器好,还是直接GPU服务器托管呢?这两者有啥区别,哪个更合适?

先说云服务器吧。如果你只是偶尔用用,需求量不大,或者项目还在起步阶段,买云服务器其实挺方便的。云服务器不需要你自己操心硬件维护,开通马上能用,弹性也大,按需付费,挺灵活的。比如你做个小型的深度学习实验,或者跑个AI模型测试,云服务器就很合适。

但如果需求变大了,比如你公司的AI项目越来越重,模型越来越复杂,算力需求猛涨,这时候单纯买云服务器成本就高了,资源也可能不够稳定。特别是一些长时间、高强度的任务,比如深度学习训练、科学计算、视频渲染这类重负载应用,云上花钱就特别快,性价比不太划算。这个时候,GPU服务器托管就成了不错的选择。

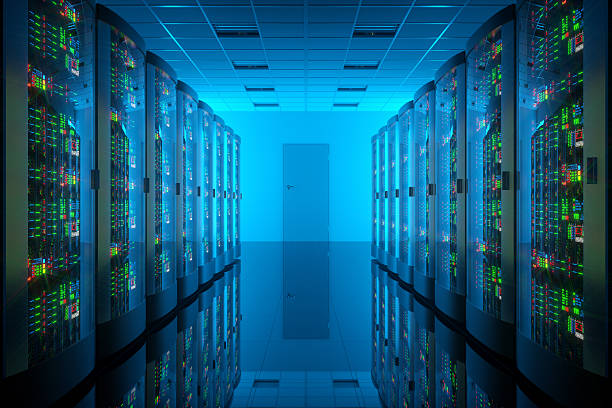

说白了,GPU服务器托管就是你自己买了物理GPU服务器,然后放到专业的数据中心托管。这样你有自己的硬件,资源专属,性能稳定,安全性也高。而且长远来看,成本控制更好。尤其适合有大规模计算需求的企业或团队,比如机器学习研发、AI算法训练、影视后期渲染、科学模拟计算这些场景。

那GPU服务器托管到底适合哪些应用场景呢?说实话,GPU的强项就是并行计算能力强,特别适合这几类:

1. 深度学习和人工智能领域,训练和推理模型都离不开GPU的加速。

2. 视频和图像渲染,比如影视特效、三维动画制作,需要大量图形计算。

3. 科学计算,比如物理模拟、基因测序、天气预报仿真,这些都靠GPU才能高效完成。

4. 大数据分析和机器学习,复杂的数据处理也能从GPU加速中获益。

换句话说,只要你的应用对算力有高要求,而且希望性能稳定、成本可控,GPU服务器托管就挺合适。

还有一点很重要,就是关于托管服务器选择的数据中心位置。GPU服务器用电量非常大,电费是运营成本的一大块。因此,选择数据中心时,电费便宜的地区绝对是优先考虑的。比如某些电力资源丰富且价格低廉的城市或区域,能大幅降低运营成本。

但光便宜还不够,数据中心的基础设施必须跟得上。稳定可靠的电力供应、良好的散热系统、高速网络连接和完善的安全措施,这些都是基础要求。因为GPU服务器一旦出现断电或网络问题,运算任务会被打断,影响效率和结果。

所以,理想的托管地点是电费较低,同时基础设施健全、网络环境优越的地方。这样的数据中心能帮你把GPU服务器的性能发挥到极致,同时保证系统的稳定和安全。

最后推荐一下,Vecloud在全球拥有丰富的数据中心资源,聚焦国内一线和海外IDC业务,机房提供SLA服务保障,规模大、可靠性高,可为客户的服务器系统和网络设备提供灵活、模块化和安全的运行环境。与一级运营商合作,提供高品质的网络条件。多重安全措施保障企业隐私数据的安全性,高度冗余备份方案应对突发状况。

声明:本网站发布的内容(图片、视频和文字)以用户投稿、用户转载内容为主,如果涉及侵权请尽快告知,我们将会在第一时间删除。文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:shawn.lee@vecloud.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。

本站原创内容未经允许不得转载,或转载时需注明出处:https://news.kd010.com/fwqtg/23799.html

TAG标签:AI

赞

赞 电话

电话 微信

微信